Kembali ke semua wawasan

Alasan mengapa POC Anda tidak menskalakan (dan cara memperbaikinya)

Amir Ouki

Direktur Pelaksana,

AI & Teknologi Terapan

Hangover AI

Perusahaan bangun untuk apa yang kita sebut AI Hangover: Kesadaran bahwa membuktikan sesuatu bekerja tidak sama dengan membuatnya bekerja pada skala.

Sebagian besar pembuktian Konsep AI gagal untuk meningkatkan alat-alat yang memberikan dampak bisnis nyata, meskipun banyak dari inisiatif ini menunjukkan hasil yang menjanjikan (seperti model kerja atau pengumpulan wawasan spesifik secara otomatis). Beberapa POC tidak pernah meninggalkan laboratorium, yang lain runtuh di bawah beban hutang teknis, perlawanan, atau kepemilikan yang tidak jelas.

Sebagian besar perusahaan tidak kekurangan ide AI, mereka kekurangan skala disiplin. Masa depan adalah milik mereka yang skala dengan sengaja.

Dalam posting ini, kami mengeksplorasi mengapa begitu banyak organisasi berjuang untuk pindah dari POC ke dampak perusahaan. Kami akan memecah pemblokir terbesar dari penskalaan (tetapi tidak semuanya), pergeseran teknis dan organisasi yang diperlukan untuk bergerak cepat tanpa merusak hal -hal, dan bagaimana menanamkan AI dengan cara yang terus berskala.

Menyelam lebih dalam dengan webinar kami di “Scaling AI dari POC ke Produk Bisnis-Critical”

Mengapa kebanyakan AI POC gagal skala

Saat ini, keunggulan kompetitif tidak lagi hanya tentang Eksperimen AI Tapi di seluruh perusahaan Integrasi AI. Perbedaan yang sebenarnya adalah seberapa baik skala AI lintas alur kerja, sistem, dan tim.

Kebenaran yang sulit adalah bahwa menunjukkan model yang berfungsi tidak lagi cukup. Jika POC Anda tidak dirancang untuk berintegrasi dengan sistem langsung Anda, tahan data nyata “melayang”, atau sejajar dengan alur kerja bisnis yang sebenarnya, maka penskalaan menjadi hampir mustahil.

1. Bendera merah dalam konsep bukti AI yang dapat menandakan kegagalan di masa depan

Ini adalah beberapa bendera merah yang kita lihat berkali -kali di AI POC yang dapat menandakan kegagalan proyek yang akan datang:

- Tidak ada kriteria keberhasilan yang jelas: Jika tim Anda tidak dapat mendefinisikan seperti apa “kesuksesan” di luar demo yang bekerja, Anda akan berjuang untuk membenarkan langkah-langkah selanjutnya atau mendapatkan dukungan jangka panjang.

- Ketidaksejajaran dengan strategi bisnis: POC sering terlepas dari prioritas bisnis yang sebenarnya. Mereka memecahkan masalah tidak ada yang diminta untuk menyelesaikannya.

- Teknologi yang dipimpin tanpa pemikiran produk: Banyak pilot dipimpin oleh tim teknis dengan sedikit input produk. Itu mengarah pada algoritma yang mengesankan yang tidak ada yang ingin (atau tahu caranya) digunakan.

- Tidak ada rencana di luar fase pilot: POC tanpa peta jalan hanyalah percobaan yang mahal. Tanpa strategi yang jelas untuk membawanya ke produksi, ditakdirkan untuk duduk di rak.

Ketika tim mengoptimalkan hanya untuk kelayakan teknis, mereka kehilangan gambaran yang lebih besar: penskalaan AI memerlukan penyelesaian untuk sistem, kepemilikan, dan keberlanjutan. Itu tidak harus didorong hanya oleh kinerja model. Pertanyaan inti seharusnya tidak “bisakah kita membangunnya?” Tetapi “Bisakah kita memiliki, mengembangkan, dan mengoperasionalkan ini setelah hidup?”

Sampai organisasi membuat pergeseran ini dalam pola pikir dari eksperimen lab siled ke integrasi jangka panjang, mereka akan terus menghadapi pengembalian yang semakin berkurang dari investasi AI mereka.

Lanjutkan membaca tentang bendera merah paling umum untuk diperhatikan saat membangun solusi AI Anda

2. Bagian -bagian penting dari solusi AI yang dapat diskalakan

Ketika tiba saatnya untuk beralih dari alur kerja tunggal ke lingkungan produksi, hal -hal sering retak: infrastruktur, saluran pipa data, logika pelatihan ulang, bahkan pemantauan dasar.

Inilah yang terlihat seperti hutang teknis ketika Anda skala AI terlambat. Terutama jika pilot AI Anda dioptimalkan untuk menunjukkan bahwa sesuatu dapat berhasil, bukan untuk bertahan ketika ratusan pengguna, aliran data langsung, atau persyaratan kepatuhan terlibat.

Bagaimana Anda membuat solusi Anda dapat diskalakan dan siap untuk perusahaan?

Desain Modular

Jika pilot AI Anda dibangun untuk menyelesaikan masalah yang sangat spesifik, kemungkinan besar bergantung pada format data tertentu, variabel hardcoded, dan solusi manual. Ini mungkin membuat Anda demo cepat, tetapi itu tidak akan selamat dari handoff untuk tim lain, atau ketika input berubah begitu pengguna mulai bekerja dengan alat Anda.

Infrastruktur Data

Banyak pilot AI berjalan pada dataset yang bersih dan dikuratori yang cukup kecil untuk dikelola secara manual. Dalam skala, segalanya menjadi berantakan, dan infrastruktur data menjadi produknya sendiri. Anda akan berhadapan dengan tantangan seperti input pengguna yang tidak dapat diprediksi atau permintaan bandwidth dari permintaan data real-time.

OP Model

AI pada skala lebih dari penempatan satu kali; itu membutuhkan orkestrasi yang sangat spesifik.

Anda tidak ingin model bisnis-kritis Anda rusak karena seseorang secara manual memperbaruinya pada hari Kamis dan lupa untuk menguji kasus tepi.

Rencanakan Penurunan Kinerja

Setelah model ditayangkan, ia akan menghadapi kondisi yang tidak pernah dilatih. Drift tidak bisa dihindari pada tahap ini. Yang penting adalah seberapa cepat dan seberapa aman Anda dapat merespons, yang tergantung pada solusi Anda kemampuan deteksi drift. Tanpa pemantauan waktu nyata, peringatan, dan pelatihan ulang pemicu, tim sering menemukan masalah hanya setelah mereka menyebabkan dampak bisnis negatif.

3. Menghadap Tata Kelola, Kepercayaan dan Risiko

Tata kelola

Tata kelola adalah apa yang memisahkan eksperimen AI yang menjanjikan dari produk yang dapat diukur dan dapat dipercaya. Namun, ini sering menjadi salah satu aspek pengembangan AI yang paling diabaikan.

Ketika AI tinggal di laboratorium, tidak ada yang terlalu khawatir tentang audit keamanan, kepatuhan GDPR, atau apa yang terjadi ketika model membuat prediksi yang buruk. Tetapi begitu sistem AI Anda mencapai pelanggan nyata dan perlu membuat keputusan nyata dan pendapatan aktual, taruhannya berubah.

Model yang secara teknis brilian masih bisa gagal jika orang tidak mempercayainya. Kepercayaan itu tidak diperoleh dengan skor akurasi saja, itu harus diperoleh transparansi, akuntabilitas, dan kontrol. Tanpa kemampuan menjelaskan, pemantauan bias, dan kontrol akses, model Anda mungkin benar tetapi tidak dapat digunakan.

Privasi dan kepatuhan masih menjadi tanggung jawab Anda

SCALING AI berarti memastikan solusinya siap untuk semua pengawasan regulasi, seperti GDPR, HIPAA, atau standar regional lainnya. Setiap sistem AI yang diskalakan juga merupakan permukaan serangan baru. Jika model Anda terpapar melalui API, terima input pengguna, atau berinteraksi dengan data sensitif, itu perlu dilindungi. Dalam skala, proses Anda harus mencakup perlindungan yang ketat terhadap serangan umum dan kelemahan keamanan

4. Pemikiran Proyek (daripada Berpikir Platform)

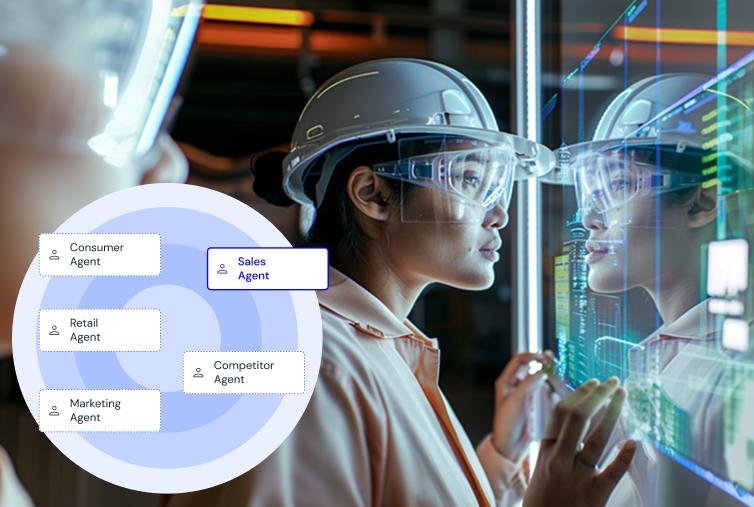

Ketika setiap solusi AI dibangun dari awal, penskalaan menyakitkan dan lambat. Tim duplikat pekerjaan. Model sulit untuk mengatur. Bakat tidak transfer dengan mudah di antara proyek.

Tetapi dengan pendekatan platform, penurunan waktu untuk mengurangi, tata kelola terstandarisasi, dan kontrol akses konsisten di seluruh alat. Kolaborasi lintas tim meningkat: Ilmuwan data, insinyur, dan pemilik bisnis berbagi fondasi umum. Dan senyawa dampak. Perbaikan pada layanan bersama mulai menguntungkan setiap kasus penggunaan yang bergantung pada mereka, bukan hanya satu tim yang beroperasi di lingkungan yang dibungkam.

Pindah ke model platform bukan hanya tentang arsitektur perangkat lunak, ini adalah perubahan organisasi. Ini berarti memprioritaskan pemberdayaan daripada kepemilikan, dan memberi tim alat dan standar untuk membangun secara bertanggung jawab dan mandiri, daripada penjaga gerbang AI melalui tim pusat.

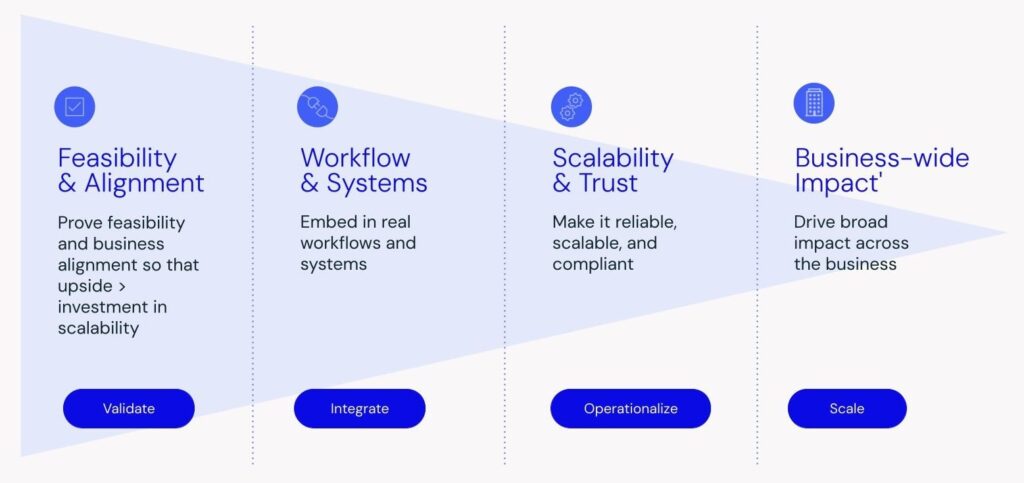

Pelajari lebih lanjut tentang apa yang sebenarnya dibutuhkan AI penskalaan, dan bagaimana mendekatinya dalam 4 tahap

5. Kesiapan organisasi kurang

Bahkan sistem AI yang dirancang terbaik tidak akan skala jika organisasi tidak siap untuk mereka. Kami telah melihat model yang sangat berkinerja terhenti bukan karena teknologi tidak berfungsi, tetapi karena bisnis tidak terstruktur atau terampil untuk mengadopsi, mengoperasikan, atau mempercayai solusinya.

Itu sebabnya penskalaan AI sama halnya dengan transformasi budaya seperti halnya teknis.

Kemampuan baru membutuhkan peran baru

AI pada skala tidak berjalan dengan autopilot. Ini membutuhkan pemeran pendukung peran khusus untuk mempertahankan, mengatur, dan meningkatkan sistem dari waktu ke waktu. Ini termasuk:

- Pemilik Produk AI Tertanam di unit bisnis untuk mendefinisikan kasus dan hasil penggunaan dunia nyata

- Insinyur OPS Model Bertanggung jawab untuk penyebaran, pemantauan, dan pelatihan ulang pipa

- Insinyur cepat Model generatif yang menyempurnakan dan menyusun logika input/output

- Pelayan data memastikan kualitas data, garis keturunan, dan kepatuhan kebijakan

Jika peran ini tidak ada (atau jika tanggung jawab tidak jelas), solusi AI menjadi yatim setelah penyebaran. Tidak ada yang memilikinya → tidak ada yang memperbaruinya → tidak ada yang mempercayai mereka.

Penyelarasan lintas fungsional bukan opsional

AI tinggal di persimpangan strategi, produk, teknik, dan kepatuhan. Itu membuat kolaborasi di seluruh tim penting. Solusi AI yang paling terukur tidak dibangun di silo. Mereka muncul dari tim di mana:

- Pimpinan Bisnis Menentukan Hasil dan Kriteria Keberhasilan

- Insinyur Membangun Sistem Modular yang Dapat Dipelihara

- Tim legal dan kepatuhan membentuk tata kelola dari hari pertama

- Pengguna akhir terlibat lebih awal untuk membentuk dan menguji stres solusinya

Ketika penyelarasan hilang, Anda mendapatkan alat AI yang tidak diinginkan siapa pun, tidak ada yang mengerti, atau tidak ada yang dapat menggunakan dengan aman.

Adopsi gagal ketika kesesuaian budaya salah

Kegagalan adopsi yang paling umum tidak teknis Tetapi perilaku:

- Alat ini tidak cocok dengan alur kerja yang ada

- Tim tidak mengerti bagaimana itu dibangun atau bagaimana menggunakannya

- Tidak ada kasus bisnis yang jelas untuk mendukung investasi berkelanjutan

Untuk mengatasi ini, Anda membutuhkan lebih dari sekadar onboarding. Anda membutuhkan kelancaran organisasi: bahasa bersama, harapan yang jelas, dan budaya yang melihat AI sebagai alat untuk digunakan dan ditingkatkan, tidak ditakuti atau disalahpahami.

Pahami apa yang dibutuhkan agar solusi AI Anda aman, tepercaya, dan diatur dengan benar

Penskalaan adalah bagian yang sulit. Tapi di sanalah nilainya.

Siapa pun dapat memutar bukti konsep. Sebagian besar organisasi memiliki lusinan dari mereka yang duduk di slide, laboratorium, atau repo GitHub. Apa yang memisahkan para pemimpin hari ini bukanlah jumlah pilot yang telah mereka jalankan tetapi jumlah sistem yang telah mereka scaling.

POC mungkin menunjukkan potensi, tetapi AI kelas perusahaan menghasilkan terukur, peracikan dampak:

- Ini meningkatkan kecepatan dan akurasi pengambilan keputusan di seluruh departemen

- Ini membuka kunci pendapatan baru dengan memungkinkan kemampuan yang sebelumnya tidak mungkin

- Ini mendorong efisiensi pada skala, membebaskan sumber daya untuk pekerjaan bernilai lebih tinggi

- Ini membangun infrastruktur yang dapat digunakan kembali orang lain untuk memecahkan masalah baru lebih cepat

Penskalaan mengharuskan Anda untuk menyelesaikan seluruh sistem

Mari kita rekap apa yang sebenarnya diperlukan untuk skala:

- Arsitek untuk Modularitas: membangun komponen fleksibel yang dapat berevolusi dan saling berhubungan

- Investasikan dalam infrastruktur: Aktifkan versi, pemantauan, pelatihan ulang, dan rollback

- Embed Governance Early: Pastikan kepercayaan, transparansi, dan kepatuhan dengan desain

- Bergeser ke platform thinking: Reuse Models, Tooling, dan Data Pipeline di seluruh Kasing Penggunaan

- Bangun kefasihan organisasi: melengkapi tim untuk memahami, menggunakan, dan mempertahankan AI secara bertanggung jawab

- Desain untuk Kepemilikan: Definisikan siapa yang memiliki apa setelah go-live, dan bagaimana itu meningkat dari waktu ke waktu

SCALING AI bukan garis finish untuk mencapai di akhir tahap pengembangan. Itu kemampuan. Dan seperti kemampuan inti apa pun, itu hanya memberikan ketika terstruktur, didukung, dan sengaja tertanam ke dalam bagaimana bisnis beroperasi, didukung oleh strategi AI yang jelas.

Ingin membangun solusi AI yang memberikan nilai bisnis nyata pada skala? Mari kita bicara.

Amir Ouki

Direktur Pelaksana, AI & Teknologi Terapan

Amir memimpin tim global BOI tentang ahli strategi produk, desainer, dan insinyur dalam merancang dan membangun teknologi AI yang mengubah peran, fungsi, dan bisnis. Amir suka memecahkan tantangan dunia nyata yang kompleks yang memiliki dampak langsung, dan terutama berfokus pada perangkat lunak yang dipimpin KPI yang mendorong pertumbuhan dan inovasi di atas dan bawah. Dia sering dapat ditemukan (secara objektif) mengevaluasi dan menilai teknologi baru yang dapat bermanfaat bagi klien kami dan telah meluncurkan produk dengan antropik, Apple, Netflix, Palantir, Google, Twitch, Bank of America, dan lainnya.

Terus belajar

Lebih banyak sumber daya pada strategi dan membangun AI

Webinar

Menskalakan AI dari POC ke produk yang sangat penting

Blog

Mengapa Anda membutuhkan strategi AI: 4 hambatan mencegah Anda menangkap nilai

Blog

Apa yang sebenarnya dibutuhkan AI penskalaan: 4 tahap

KTT terbesar di dunia untuk inovator AI kembali pada bulan Desember

Tiket tersedia sekarang

Posting Alasan mengapa POC Anda tidak menskalakan (dan cara memperbaikinya) muncul pertama kali di BOI (Dewan Inovasi).